运营商大规模数据集群治理实践指南 面向网络运营服务的挑战与应对

随着5G、物联网及边缘计算的快速发展,运营商网络运营服务正面临前所未有的数据洪流。大规模数据集群作为支撑网络监控、故障诊断、用户行为分析和资源调度的核心基础设施,其治理水平直接关系到网络服务质量、运维效率与业务创新。在实践过程中,运营商往往面临数据孤岛、实时性不足、资源利用率低、安全合规等多重挑战。本文将系统梳理运营商大规模数据集群治理的关键问题,并提出面向网络运营服务的实践指南。

一、核心问题剖析

- 数据孤岛与整合难题:运营商网络数据来源多样,包括网元日志、信令数据、性能指标、用户账单等,这些数据通常分散在不同系统、格式和协议中,形成“数据烟囱”。缺乏统一的数据模型与接入标准,导致跨域分析困难,影响端到端服务质量监控与根因定位。

- 实时处理能力瓶颈:网络运营要求毫秒级故障检测与秒级响应,但传统批处理架构难以满足实时性需求。流式计算框架(如Flink、Storm)的引入又带来资源调度、状态管理和容错复杂性。

- 资源利用率与成本矛盾:为应对业务峰值,集群常按峰值需求配置资源,但在低谷期资源闲置率高。计算、存储与网络资源缺乏协同优化,导致硬件投资回报率低。

- 数据质量与一致性挑战:因数据采集丢包、传输延迟或格式错误,原始数据常存在噪声与缺失。缺乏闭环的数据质量监控体系,影响分析结果的可靠性。

- 安全与合规风险:运营商数据涉及用户隐私(如位置、通信记录)和网络敏感信息,需满足GDPR、网络安全法等法规要求。数据跨集群流动时的加密、脱敏与访问控制机制若不到位,易引发合规漏洞。

二、治理实践指南

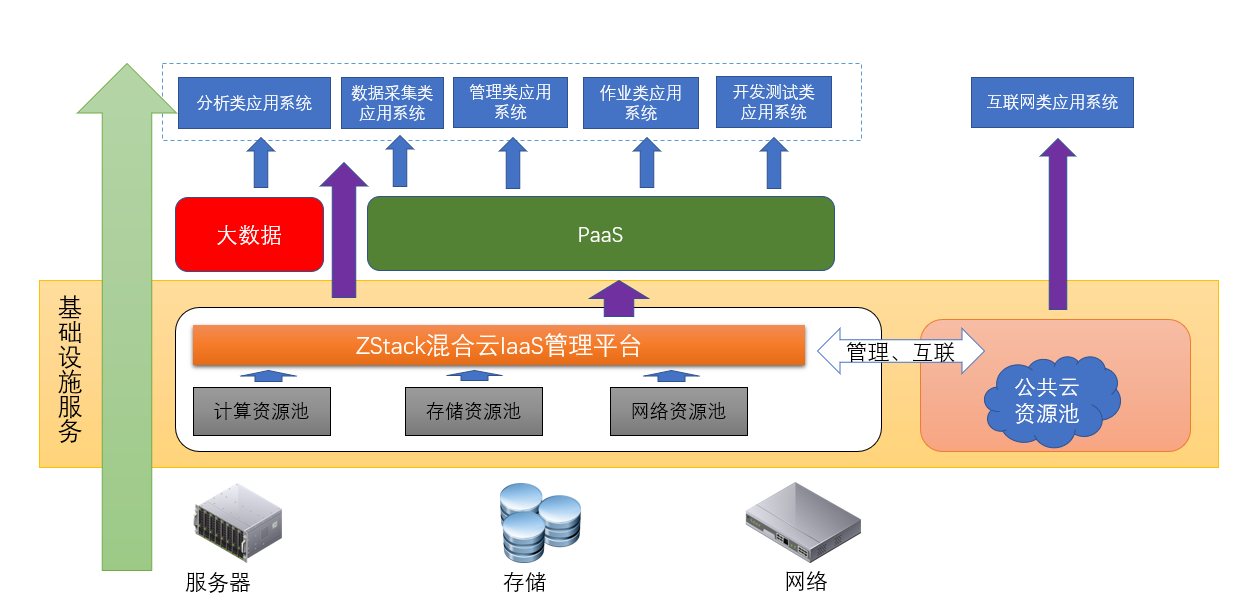

- 构建统一数据中台:建立标准化数据接入层,通过协议适配、格式转换与元数据管理,将多源数据整合为“逻辑统一”的数据湖。定义网络领域数据模型(如3GPP TS 32.422),实现网元、接口、用户等实体关系的标准化描述。

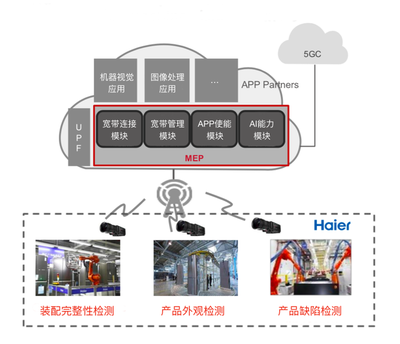

- 推行混合计算架构:采用“批流一体”架构(如Apache Iceberg + Flink),在统一存储上支持实时流处理与离线分析。通过动态资源调度(如Kubernetes + YARN),实现计算任务优先级划分与弹性伸缩,兼顾实时告警与深度挖掘需求。

- 实施智能资源治理:引入AIOps技术,基于历史负载预测业务趋势,实现集群资源的自动扩缩容。采用存储分层策略(热数据SSD、温数据HDD、冷数据对象存储),结合数据生命周期管理,降低存储成本。

- 强化数据质量管控:建立端到端数据质量监控流水线,包括采集完整性校验、实时血缘追踪、异常值检测与自动修复。定义网络数据质量指标(如时延准确率、丢包率一致性),并纳入运维KPI考核体系。

- 完善安全合规框架:实施数据分类分级,对敏感数据实施加密存储与传输(如TLS 1.3、国密算法)。部署隐私计算技术(如联邦学习),在保证数据不出域的前提下支持联合建模。建立审计日志全量记录与合规性自动巡检机制。

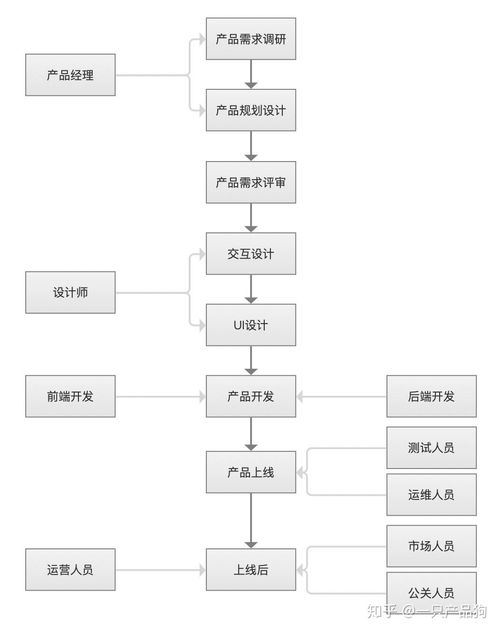

- 推进组织与流程变革:设立数据治理委员会,明确网络、IT与安全部门的权责。推行DevOps与DataOps文化,通过自动化工具链实现数据管道开发、测试与部署的一体化,提升跨团队协作效率。

三、未来展望

随着6G与算力网络的发展,运营商数据集群将向“云网边端”协同的分布式架构演进。治理重点需从中心化集群扩展至边缘节点动态管理,并探索区块链存证、机密计算等新技术在数据可信共享中的应用。唯有持续优化治理体系,运营商才能将数据资产转化为网络自智化、服务差异化的核心动能,在数字化浪潮中赢得先机。

大规模数据集群治理是一项系统工程,需技术、流程与组织三者协同。运营商应立足网络运营场景,以问题为导向,分阶段推进治理实践,最终实现数据驱动的智慧运营。